爬虫

什么是爬虫:

- 通过编写程序,模拟浏览器上网,然后让其去互联网上抓取数据的过程。爬虫究竟是合法还是违法的?

- 在法律中是不被禁止

- 具有违法风险

- 善意爬虫 恶意爬虫

爬虫带来的风险可以体现在如下2方面:

– 爬虫干扰了被访问网站的正常运营

– 爬虫抓取了收到法律保护的特定类型的数据或信息

如何在使用编写爬虫的过程中避免进入局子的厄运呢?

- 时常的优化自己的程序,避免干扰被访问网站的正常运行 - 在使用,传播爬取到的数据时,审查抓取到的内容,如果发现了涉及到用户隐私 商业机密等敏感内容需要及时停止爬取或传播爬虫在使用场景中的分类 - 通用爬虫: 抓取系统重要组成部分。抓取的是一整张页面数据。 - 聚焦爬虫: 是建立在通用爬虫的基础之上。抓取的是页面中特定的局部内容。 - 增量式爬虫: 检测网站中数据更新的情况。只会抓取网站中最新更新出来的数据。反爬机制:门户网站,可以通过制定相应的策略或者技术手段,防止爬虫程序进行网站数据的爬取。

反反爬策略:爬虫程序可以通过制定相关的策略或者技术手段,破解门户网站中具备的反爬机制,从而可以获取门户网站中相关的数据。

robots.txt协议: 君子协议。规定了网站中哪些数据可以被爬虫爬取哪些数据不可以被爬取。

requests模块

1.什么是requests模块 - python原生一个基于网络请求的模块,模拟浏览器发起请求。- 2.为什么要使用requests模块 - 1.自动处理url编码 - 2.自动处理post请求的参数 - 3.简化cookie的代理的操作: cookie操作: - 创建一个cookiejar对象 - 创建一个handler对象 - 创建一个operner 代理操作: - 创建handler对象,代理ip和端口封装到该对象 - 创建openner对象- 3.requests如何被使用 - 安装:pip install requests - 使用流程: - 1.指定url - 2.使用requests模块发起请求 - 3.获取响应数据 - 4.进行持久化存储- 4.通过5个基于requests模块的爬虫项目对该模块进行系统学习和巩固 - get请求 - post请求 - ajax的get - ajax的post - 综合如何使用:(requests模块的编码流程)

– 指定url

– UA伪装

– 请求参数的处理

– 发起请求

– 获取响应数据

– 持久化存储

实战编码:

– 需求:爬取首页的页面数据

#指定urlurl = "https://www.luffycity.com/"#发起请求#获取响应数据res = requests.get(url = url)data = res.text

网页采集器

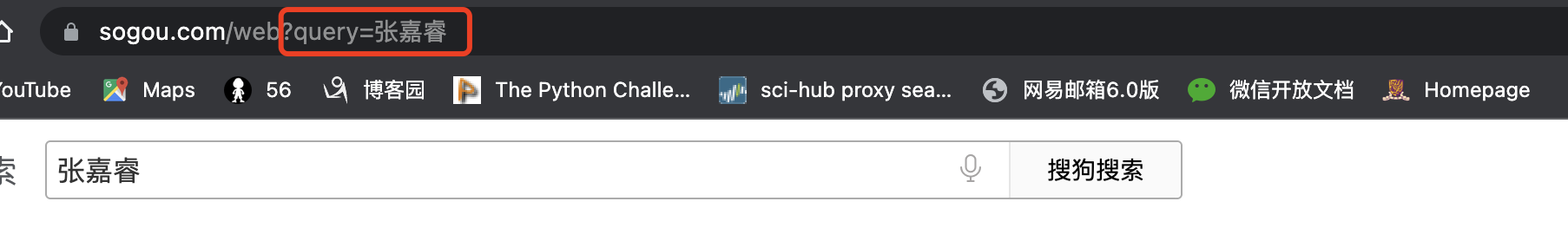

动态搜索的话,我们需要自定义请求

#处理url携带的参数:封装到字典中 kw = input('enter a word:') param = { 'query':kw } #对指定的url发起的请求对应的url是携带参数的,并且请求过程中处理了参数 res = requests.get(url=url, params=param) #带参数对指定url发起请求 page_text = res.text print(page_text)UA伪装:让爬虫对应的请求载体身份标识伪装成某一款浏览器

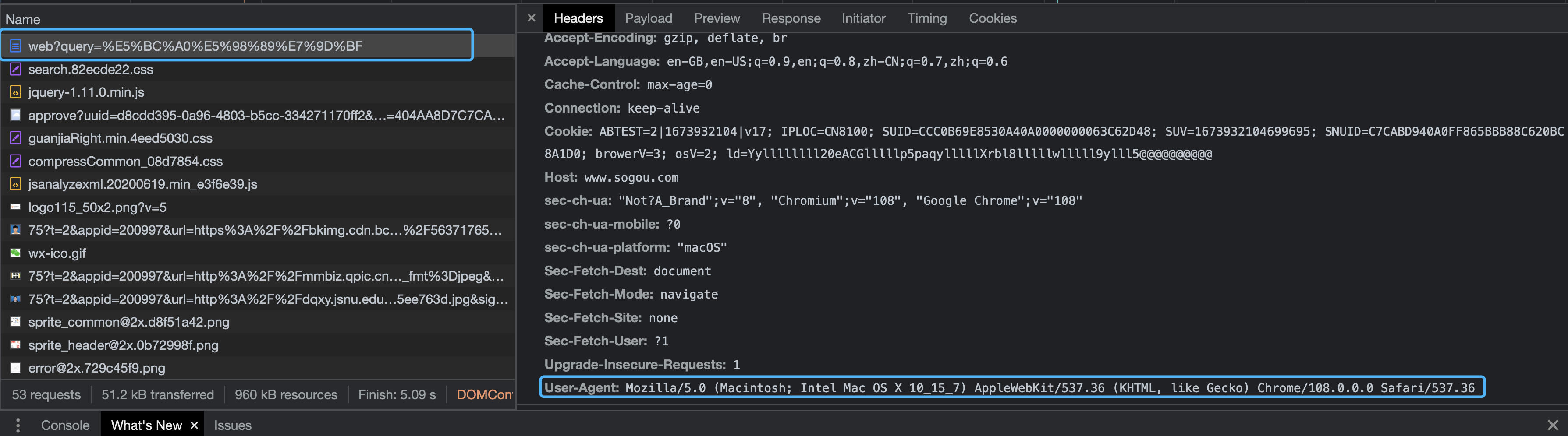

UA:User-Agent(请求载体的身份标识)UA检测:门户网站的服务器会检测对应请求的载体身份标识,如果检测到请求的载体身份标识为某一款浏览器,说明该请求是一个正常的请求。但是,如果检测到请求的载体身份标识不是基于某一款浏览器的,则表示该请求为不正常的请求(爬虫),则服务器端就很有可能拒绝该次请求。

这是正常浏览器所以使用的用户代理,将这个写到代码中就会伪装成浏览器请求

header = { 'User-Agent': 'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_15_7) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/108.0.0.0 Safari/537.36' #这一步也可以通过抓包拦截获取 } url = 'https://www.sogou.com/web?' kw = input() param ={ "query" :kw } res = requests.get(url=url, params=param,headers=header) #带参数对指定url发起请求破解百度翻译

蓝色框是我们想要得到的东西。

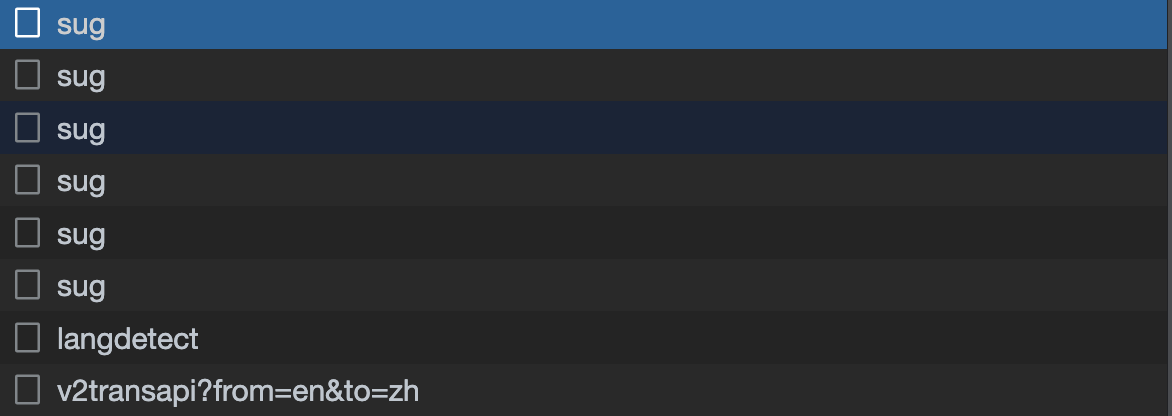

当在搜索框中输入之后,服务器会通过ajax请求提交,所以我们可以去捕获XHR类型的请求

以输入regina为例,可以得到以下的数据包,一共是6个sug和其他文件。依次打开,我们会发现每输入一个字母

浏览器就会提交一次ajax请求,所以我们可以找到最后一次提交的文件

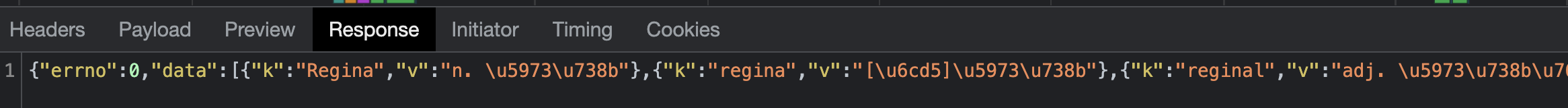

Request URL: https://fanyi.baidu.com/sugRequest Method: POSTStatus Code: 200 OKRemote Address: 103.235.46.58:443Referrer Policy: strict-origin-when-cross-originContent-Type: application/jsonDate: Tue, 17 Jan 2023 05:38:54 GMTFORM DATA:kw:regina数据是通过post请求提交,并且参数有一个我们要输入的东西,url如上所示

#1.指定url post_url = 'https://fanyi.baidu.com/sug' #2.进行UA伪装 headers = { 'User-Agent': 'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_15_7) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/108.0.0.0 Safari/537.36' } #3.post请求参数处理(同get请求一致) word = input('enter a word:') data = { 'kw':word } #4.请求发送 response = requests.post(url=post_url,data=data,headers=headers)我们看到响应数据是json类型,可以使用json方法来得到结果

#5.获取响应数据:json()方法返回的是obj(如果确认响应数据是json类型的,才可以使用json()) dic_obj = response.json()#持久化存储 fileName = word+'.json' fp = open(fileName,'w',encoding='utf-8') json.dump(dic_obj,fp=fp,ensure_ascii=False) #中文无法ascii码编码本文来自博客园,作者:ivanlee717,转载请注明原文链接:https://www.cnblogs.com/ivanlee717/p/17078664.html